Bu kısa yazıda sağduyu (common sense) ve bağlam (context) kavramlarının yapay zekâ’da anlaşılma biçimini ve gerçekleştirimini incelemek istiyorum.

Yapay zeka’nın kurulduğu yıllardan beri aklı selim (Türk Dil Kurumu’na göre, common sense’in karşılığı bu; TDK sağduyuya hissi selim diyor) etkin araştırma konusu oldu. Yapay zekâ’nın kurucusu iki isim öne çıkıyor. Biri John McCarthy, diğeri de Marvin Minsky. İkisini de yitirdik ama onlar için kurucu önderler diyebiliriz. John McCarthy’nin çok eski bir çalışmasının başlığı “Sağduyu Sahibi Bilgisayarlar” idi. Bilgisayarların doğduğu yıllarda yazılmış bir makaledir. Aynen Alan Turing’in bilgisayarların başlangıç zamanlarında “Bilgisayarlar Acaba Düşünebilir mi?” sorusunu irdelediği ve Turing Testi’ni önerdiği makalesi gibi. Kurucu isimlerde daha fütüristik diyebileceğimiz temalara yanıt arama çabası görüyoruz. McCarthy bunu, sağduyulu akıl yürütmeyi programların yapabileceğini ve bunun için de matematiksel mantıkla, örneğin Lisp veya Prolog gibi bir dil kullanarak, birtakım kurallar yazılabileceğini ve bunların bilgisayar tarafından yürütülmesi halinde sağduyunun ortaya çıkabileceğini düşünüyordu. Takip eden yıllarda bunu Doug Lenat adında yine yitirdiğimiz bir yapay zekâ öncüsü Cyc (ansiklopedi’den kısaltma) programıyla başarmaya çalıştı. Çok büyük ölçekli bir programdı Cyc. Amacı sağduyuyu bilgisayara geçirmekti diyebiliriz. Ne var ki program özel durumlarda çalıştı ama duvara çarptı: genelleşmediği anlaşıldı. Minsky’nin yine bu konuda çalışmaları oldu. Aynı zamanda bilişsel bilim uzmanı olan Minsky’nin insan aklını özelleşmiş ve aralarında etkileşen bir akılsız (dumb) agent’lar topluluğu olarak gören eseri ve onu izleyen ‘duygu makinesi’ önerisi ilgi uyandırdı.

Kanımca bağlam ve sağduyu günümüzdeki önemli iki bilgisayar bilimi sorunudur ve tam olarak çözülmemişlerdir. Ama bağlam konusunda, günümüzdeki gelişmeler ışığında daha olumlu düşünüyorum. Bağlam, metin temelinde düşünürsek, okuduğumuz bir cümlenin tam olarak ne demek istediğini doğru olarak anlayabilmeyi sağlayan her şeydir diyebiliriz. Roman okurken kişi ve olayları anlamamızı sağlayan öğe bağlamdır. Bir kişiden bahsedildiği zaman o kişinin az önce bakkala gitmiş olan kişi olduğunu anlayabiliyorsak, bunu bağlam sayesinde yapabiliyoruz. Veya bir kadının mektup yazdığı kişinin aslında Paris’teki değil Madrid’deki arkadaşı olduğunu fark ettiğimizde bunu yine bağlam sayesinde yapabiliyoruz. Bağlamı bir bilgisayarın eksiksiz ve doğru analiz edebilmesi insanlık için çok önemli bir kazanım olacaktır. Biz bunu doğru yaptığımıza inanıyoruz, insanlar olarak. Tabii bizim de bağlam hatalarımız her zaman olabilir. Roman okurken de olur bu yanlış anlamalar, film seyrederken de. Ama geri dönüp bunları kolaylıkla düzeltiriz. O açıdan bağlam hakikaten yapay zekâ’daki anahtar kavramlardan bir tanesi. McCarthy’e göre aynen sağduyu gibi bağlam da mantık ekseninde şekillendirilebilir, böylesi bir gösterim tarzı ve hesaplama yöntemiyle elde edilebilirdi. Cyc bu yolu denedi ve yıllarca uğraştıktan sonra başarısız oldu.

Yapay zekâ’daki mücadele–bir tarafta sembolik yapay zekâ yani mantıkçı anlayış, diğer yanda sinir ağları (neural nets)–70 sene sürdü. Bugün inkâr edemeyeceğimiz bir gerçek var. Çekişmenin galibi belli olmuştur ve sembolik gösterime dayanmayan (nümerik olan) sinir ağları yaklaşımıdır. Daha da ayrıntılı söylersek, derin öğrenme yaklaşımı ve onun varyasyonlarıdır. Ve sembolik yaklaşım bilim tarihinin bir merhalesi olarak geçmişte kalmıştır. Bugünkü modeller, ki büyük dil modelleridir bunlar (large language models), gündelik yaşamda karşılaştığımız bazı sorunları çözmeyi artık başarabiliyorlar. Bunu kısaca değerlendirmek isterim. Grok gibi, ChatGPT gibi programların hepsi aynı amaca hizmet ediyorlar ama aynı cevapları vermiyorlar sorgularınıza. Marksist ekonomi kitapları şöyle der: kapitalizm, malların raflarda bol ve çeşitli olduğu bir sistemdir. Çeşitli programların olması (bunlar en azından şu anda erişime açık, ücretsiz kullanılabiliyor) sonuçta iyi bir şey. Baktığımız zaman bunların bağlam konusunda gayet iyi olduklarını görüyoruz. Daha önceki sorularınızı, diyalogları, anekdotları vb. iyi hatırlıyorlar ve doğru olarak analiz edip size tutarlı yanıtlar veriyorlar. Çok sık olmasa da hata yapabilirler. Bu onların değerine asla gölge düşürmez. Çünkü şunu unutmamak lazım. Bu programlar son yıllarda ortaya çıktı. Önümüzdeki yıllarda bizi neler bekliyor bilmiyoruz. Ayrıca bağlamsal anlamanın yüzde yüz doğru olarak nasıl yapılabileceği soyut bir soru oluyor. Çünkü acaba böyle bir şey olabilir mi? (Yalnız Tanrı bağlam hataları yapmaz.)

Sonuç olarak bağlam probleminin önemli ölçüde çözüldüğünü düşünüyorum. Fakat geriye kalan ikinci büyük problem, sağduyulu düşünme, konusunda aynı şeyi söyleyemeyeceğim. Örneğin ben Grok ve ChatGPT çok kullanan bir insanım. İkisinin de yüksek sağduyu yeteneklerine sahip olduğunu görüyorum. Beş sene, on sene sonrasını düşündüğümüzde–ilerlemenin kesintisiz devam edeceğini ve insanlığı tehdit eden boyuta gelmeyeceğini farz ederek (bkz. Eliezer Yudkowsky)–bunların bağlam çözümleme ve sağduyulu davranma becerileri çok daha yetkinleşecektir.

Her hâlükârda, bağlam olsun, sağduyu olsun, bir programa güvenmekten (trust) bahsediyoruz. Karşımızda bir makina var. Güven konusunu cep telefonuna güven, dizüstü bilgisayara güven, uçağa güven, asma köprüye güven, nükleer santrale güvenden farklı algılamıyorum. Çünkü bunlar insan tarafından tasarlanmış şeyler ve sonuç olarak içlerinde güvenilmez birtakım öğeler mutlaka barındıracaklar. Beyin, meşhur tanıma göre görebildiğimiz evrendeki en entrikalı makina, nasıl çalıştığını henüz çok az anladığımız. Ve o bile tam güvenilebilir bir makina değil. (Tıbbın psikiyatri diye bir dalı var.)

Burada söylenecek ve aslında biraz umut kırıcı şey şu. Sözünü ettiğimiz programlar, yani yazı, ses, resim, video vb. aracılığıyla etkileşim sağlayan dil modelleri, dünya hakkındaki bilgilerini metinlere borçlular. Ama bir sonraki aşama olan dünya modelleri (world models) dünyadaki değişiklikler ve bunları yaratan aksiyonlar kısmına giriyor. Artık dilden (linguistik) çıkıp gerçek dünyaya (fizik) geçiyoruz. Orada bazı aksiyonlar geri döndürülemez. (Yanan bir evi geri getiremeyiz.) Orada nasıl sağduyulu davranılır? Oradaki bağlamlar nasıl kavranılır? (İngiltere kraliçesinin önünde reverans yaparım da teyzemin önünde yapmam gibi. Bu düğmeye basarsam zemin kata su gitmez ama şu düğmeye basarsam yangın acil hatları iptal olur gibi.) Dil modelleri ve dünya modelleri bu anlamda mutlaka yanlışlar yapacaklar. Bunların ortadan tümüyle kaldırılması zor, umut kırıcı olan bu. (Dünyanın en iyi modeli kendisidir!)

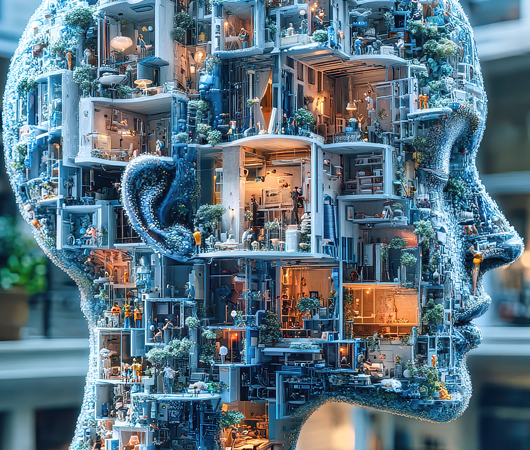

Modelleri üreten şirketlerin, çalıştırdıkları yıldız araştırmacıların işi de zor. Çünkü tabiatı gereği durum aynen beyindeki gibi. Söz konusu modeller beyin tarzında çalıştıkları için entegre ve dağıtık bir sistemden bahsediyoruz. Yani milyonlarca hesap makinesi birbirlerine çok sayıda bağlantıyla bağlı. Bize yanıtlar veren bu mimari, ona hiç kuşku yok. Nedensellik ilişkisi olarak baktığımızda beynim de konuşmamı, düşünmemi vb. sağlıyor. Mimarisi de ChatGPT’ye o şekilde davranma yeteneğini veriyor. Fakat bu altyapının pek sık olmasa da ortaya çıkabilecek hatalardan arındırılması hakikaten zor. Çünkü gözlemlediğimiz bir hatanın lokalize edilmesi ve programı değiştirerek giderilmesi çok zahmetli. İnsan havsalasının alamayacağı kadar girift bir enterkonnekte sistemden bahsediyoruz. Dolayısıyla, ancak sofistike programlar kullanarak anlamaya çalışabileceğimiz bir model bu. ChatGPT’yi en iyi nasıl debug edebiliriz? Büyük ihtimalle yine ChatGPT’yi kullanarak edebiliriz. (Ya da örneğin Grok’u kullanarak.) Belki bu programlar birbirleri ile ‘gerçeği bulma’ komisyonları kurarak çalışabilirler ve karşılıklı hatalarını düzeltmek için yorulmadan uğraşabilirler. (İş birliği ve yardımın öne çıktığı, içinde yaşadığımız dünyadan oldukça farklı bir ütopya?)

Sonuç olarak, bu mimarilerin halüsinasyonlar veya genel anlamda güvenilirlik konusunda bir zayıflığı var diyebiliriz. Zor ve açık bir problemden bahsediyoruz ve bu konuda olumlu, en azından benim bildiğim, çığır açan bir gelişme henüz yok. Ama unutmayalım: bundan sadece birkaç yıl önce ChatGPT, Grok, Gemini vb. de yoktu. Olmadıkları gibi, böylesi güçlü–70 senedir bilgisayar camiasını meşgul eden Turing Testi’ni bir çırpıda geçerek tozlu arşivlere gönderen–programlar yaratabileceğimize dair (pek çok bilgisayar uzmanı dahil) umudumuz da yoktu.

Kaynakça

Lenat, Douglas B.; Guha, R. V.; Pittman, Karen; Pratt, Dexter; Shepherd, Mary (1990), “Cyc: Toward Programs with Common Sense”, Communications of the ACM, 33(8): 30–49.

McCarthy, John (1959), “Programs with Common Sense”, Proceedings of the Teddington Conference on the Mechanization of Thought Processes. London, Her Majesty’s Stationary Office.

McCarthy, John (1990), Formalizing Common Sense: Papers by John McCarthy. Lifschitz, Vladimir, ed. Ablex Publishing Corporation.

Minsky, Marvin (1988), The Society of Mind. Simon & Schuster.

Minsky, Marvin (2007), The Emotion Machine. Commonsense Thinking, Artificial Intelligence, and the Future of the Human Mind. Simon & Schuster.

Turing, Alan (1950), “Computing Machinery and Intelligence”, Mind, LIX (236): 433–460.

Yudkowsky, Eliezer; Soares, Nate (2025), If Anyone Builds It, Everyone Dies: Why Superhuman AI Would Kill Us All. Little, Brown and Company.

Yazı: Varol Akman – Bilkent Üniversitesi Emekli Öğretim Üyesi

Diğer Sayıları İçin: INmagazine

Not: Makalelerdeki Görüş ve Yorumlar Yazar veya Yazarlara Ait Olup, Etik ve İtibar Derneği’nin Konu ile İlgili Düşüncelerini Yansıtmamaktadır.